目次

特徴量の正規化・スケーリング・データクレンジング

以下の処理を実施

外れ値の処理(IQRによる外れ値除去)

各特徴量の四分位範囲(IQR)を計算し、外れ値(1.5IQRを超えるデータ)を削除。

これにより、極端な値が影響を及ぼさないようにする。

スケーリングと正規化(StandardScaler)

平均0、標準偏差1となるように特徴量を変換(Zスコア標準化)。

これによって、すべての特徴量が共通のスケールで扱えるようになり、学習時の効率が向上。

とのことだったが

・例の3σの外れ値を外す処理をしたことで、外れ値想定の値を省いた。

・平均 0、標準偏差 1 にて、スケーリングをおこなった。

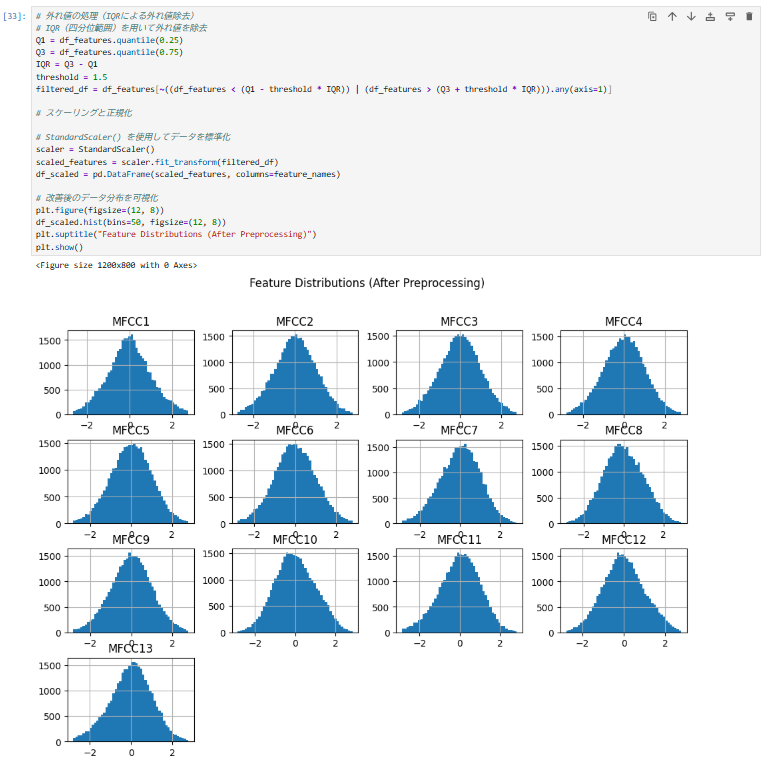

ヒストグラム ⇒ 全部似たような山なりになった

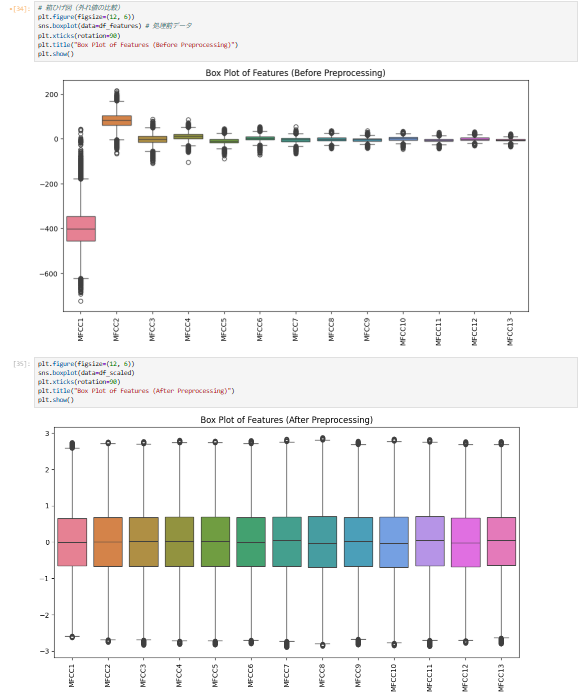

箱髭図 ⇒ 外れ値が無くなって振れ幅が一定になった

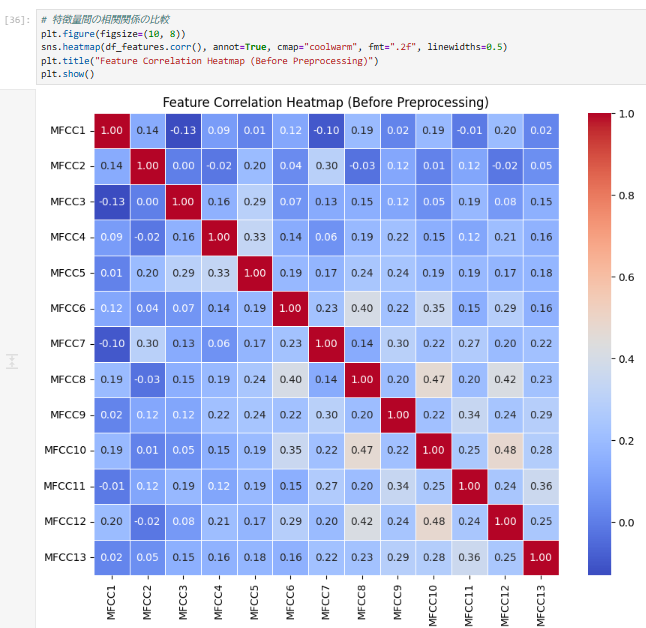

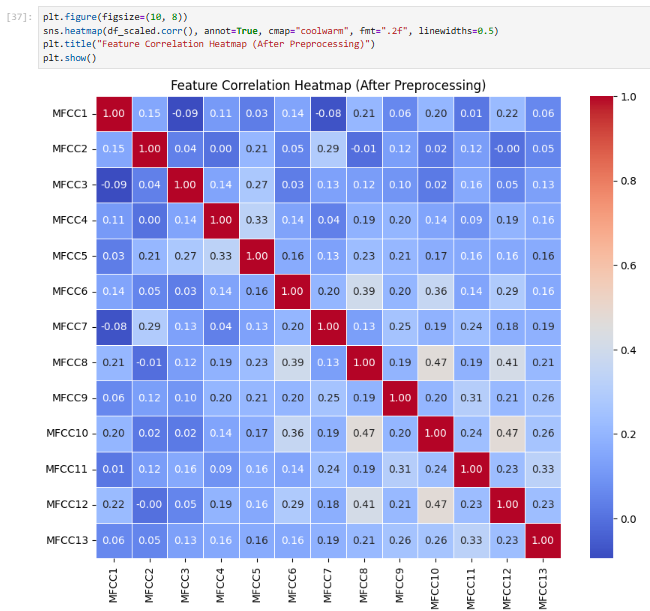

相関係数 ⇒ ぱっと見分からない・・・

何となくよくなっているようには見えるが、どうなのだろう?

モデル元の3GB以上あった音声データを聞いたわけでもない・・・

省かれたデータの音声が聞ければ別ですが。なのでこれをどう見て判断すればよいか?

確認しました。

現在の作業の位置づけ

今行っているのは、学習させる前のデータを適切な形に編集(前処理)している作業です。

この作業を行うことで、モデルが学習しやすいようにデータの品質を向上させています。

データの分割とその役割

通常、データセットは以下の3つに分割して使用します:

- 学習データ(Training Data)

- モデルを学習させるためのデータ

- データの大部分(通常70~80%)を占める

- このデータを使って、モデルのパラメータ(重みやバイアス)を最適化する

- 検証データ(Validation Data)

- モデルの調整(ハイパーパラメータのチューニング)に使うデータ

- 学習データとは別のデータを使い、モデルの汎化性能をチェックする

- 例えば、過学習を防ぐために使用する

- テストデータ(Test Data)

- 最終的な評価を行うためのデータ

- 学習・検証のどちらにも使用しなかった新しいデータで、モデルの本当の精度を測る

検証データとテストデータの違い

| 項目 | 検証データ(Validation) | テストデータ(Test) |

|---|---|---|

| 目的 | モデルのハイパーパラメータ調整や過学習のチェック | モデルの最終評価 |

| 使用タイミング | 学習の途中で使う | 学習の後、最終的に評価 |

| 学習で使う? | NO(学習には使わない) | NO(学習には使わない) |

| 本番環境に近いか? | 近いが、最終判断ではない | 本番環境でのモデルの性能に 最も近い |

今後の流れ

- 現在:

- データの前処理(正規化・スケーリング・外れ値削除)を行い、データを学習しやすい形に変換する。

- 次のステップ:

- データを学習データ、検証データ、テストデータに分割する。

- 分割後、それぞれのデータが適切に分かれているかチェックする。

- その後:

- モデルを構築し、学習データで訓練し、検証データで調整する。

- 最終的にテストデータで評価し、実際の運用でどれくらい使えるのかを確認する。

結論

- 今やっているのは「学習前のデータ準備(前処理)」

- 次にやるのは「学習用・検証用・テスト用のデータ分割」

- 検証データは学習の調整に使い、テストデータは最終評価に使う

- この流れを経て、最適なモデルを作成する

この説明で不明な点はありますか?

⇒ ある。結局、目的としている表現に近い、データの量と質が伴っていなければ最適解にならない、その目的としている表現に近いデータという答えは?

目的としている表現に近いデータの量と質をどう担保するのか?

結論から言うと、モデルが求めているデータ(目的に合った表現に近いデータ)を確保するためには、以下のポイントを抑える必要があります。

1. そもそも「目的としている表現に近いデータ」とは?

あなたのプロジェクトでは、音声データの特徴を捉え、適切な分類ができるモデルを作ることが目的です。

具体的なゴール

- 音声認識: 入力された音声が「yes」「no」などのクラスに正しく分類される

- 翻訳: STT(音声→テキスト)→ 翻訳 → TTS(テキスト→音声)で意図した翻訳ができる

- 音声の特徴量: MFCCやゼロ交差率などが、意味のある形でモデルに入力される

つまり、正しく分類・翻訳できる「質の良いデータ」が目的に合ったデータということ。

2. どの時点で「データの質」を評価するのか?

目的に合ったデータかどうかは、データ前処理の段階でチェックし、モデルの評価段階で最終的に確認します。

| 段階 | データの質を確認する方法 |

|---|---|

| データ収集 | 音声データが正しいラベルと一致しているか? |

| データ前処理(現在のステップ) | 正規化・スケーリング・外れ値削除で適切な特徴を維持できているか? |

| モデル学習・評価 | モデルが適切な精度で分類や翻訳を行えるか? |

今は**「データ前処理」のステップ**なので、モデルの学習に適した特徴量が得られているかを確認するのが目的です。

3. 目的に近いデータを得るためにするべきこと

A. データの量は十分か?

→ データが少なすぎると、過学習しやすく、汎化性能が低下する

→ データが多すぎてもノイズが増え、不要なパターンを学習する可能性がある

💡 解決策:

✅ データ拡張(Data Augmentation)

✅ バランスの良いデータセットの作成(クラスごとのデータ数を揃える)

B. データの質は適切か?

→ 不要な特徴(ノイズ)を含んでいると、モデルが誤学習する

→ 特徴が適切に抽出・スケーリングされていないと、モデルの学習が進まない

💡 解決策:

✅ 正規化(Standardization / Normalization)

✅ 外れ値の削除(IQRや3σ法)

✅ 特徴量選択(相関の強い特徴のみ使用する)

C. 目的とする表現に近いかどうかを確認するには? → どんな特徴量がモデルに適しているかをチェックする。

→ モデルの評価フェーズで、どの特徴が効果的だったか分析する。

💡 解決策:

✅ モデルを学習させた後に、特徴量の重要度を可視化する(SHAP / PCA)

✅ テストデータで分類精度を測定し、不要な特徴を削る

✅ 目的の出力(翻訳精度・音声分類精度)を人間が確認する(ヒューマンチェック)

結論

- 目的に近いデータの答えは1つではなく、段階ごとに確認していく必要がある。

- 今はデータ前処理の段階なので、データの質を向上させるための処理をしている。

- 最終的に、モデルの評価で「目的の表現に近い出力が得られているか」を判断する。

具体的な確認方法は、評価のフェーズで行う認識ということでよいですか?

⇒ はい、その認識で合っています。

具体的な確認方法(データの質の最終評価)は、モデル評価フェーズで行います。

その評価フェーズで、実際にモデルがどの程度の精度で学習・分類できるのかを確認し、

**「目的の表現に近いデータとして適切かどうか」**を判断します。

評価フェーズで行う具体的な確認方法

1. 精度(Accuracy, Precision, Recall, F1-score)の計算

- モデルの予測がどの程度正確かを測定。

- 特に、Precision(適合率)とRecall(再現率)を重視する。

- F1-scoreを使ってバランスの取れた評価を行う。

2. 混同行列(Confusion Matrix)

- どのクラスで誤分類が多いのかを分析。

- 例えば、「yes」を「no」に誤分類しやすい場合は、特徴量が適切でない可能性がある。

3. 重要な特徴量の可視化

- モデルがどの特徴を重視しているのか(SHAPやPCAで確認)。

- 不要な特徴がある場合、特徴量選択を行うことで精度向上の余地がある。

4. 実際の音声データでのテスト

- 学習データにない新しい音声データを使い、モデルが適切に分類できるか確認する。

- 人間が聞いて「この翻訳は自然か?」「分類は正しいか?」を確認するヒューマンチェック。

現在のフェーズと評価フェーズの関係

| フェーズ | 目的 |

|---|---|

| データ可視化(03) | 特徴量の分布や相関を確認 |

| データ前処理(04) | 特徴量のスケーリング・正規化・外れ値削除 |

| モデル学習(05) | 学習データを使って分類モデルを作成 |

| モデル評価(06) | 実際の精度を測定し、改善点を特定 |

現在の「データ前処理(04)」では、

**「この特徴量を使えばモデルが適切に学習できるか?」**を意識して作業しています。

その最終的な答え合わせは、**モデル評価フェーズ(06)**で行う、という流れです。

次のステップ

✅ 「データ前処理:特徴量の正規化・スケーリング・データクレンジング」が完了。

次の「モデル学習」に進める。次の作業は モデル学習 の実装。